Wdrożenie Aktu o usługach cyfrowych (Digital Services Act – DSA) w Polsce to moment zwrotny dla krajowej legislacji dotyczącej internetu. Decyzja Sejmu o przyjęciu ustawy implementującej unijne przepisy kończy okres niepewności co do kształtu nadzoru nad platformami cyfrowymi i rozpoczyna etap budowy nowych instytucji kontrolnych. Temat ten jest fundamentalny dla każdego użytkownika sieci, ponieważ redefiniuje granice wolności słowa, bezpieczeństwa oraz odpowiedzialności gigantów technologicznych za treści publikowane na ich serwerach. Poniższa analiza rozkłada nowe przepisy na czynniki pierwsze, badając mechanizmy blokowania treści oraz kontrowersje polityczne z tym związane.

Czym jest DSA i dlaczego Polska wdraża te przepisy

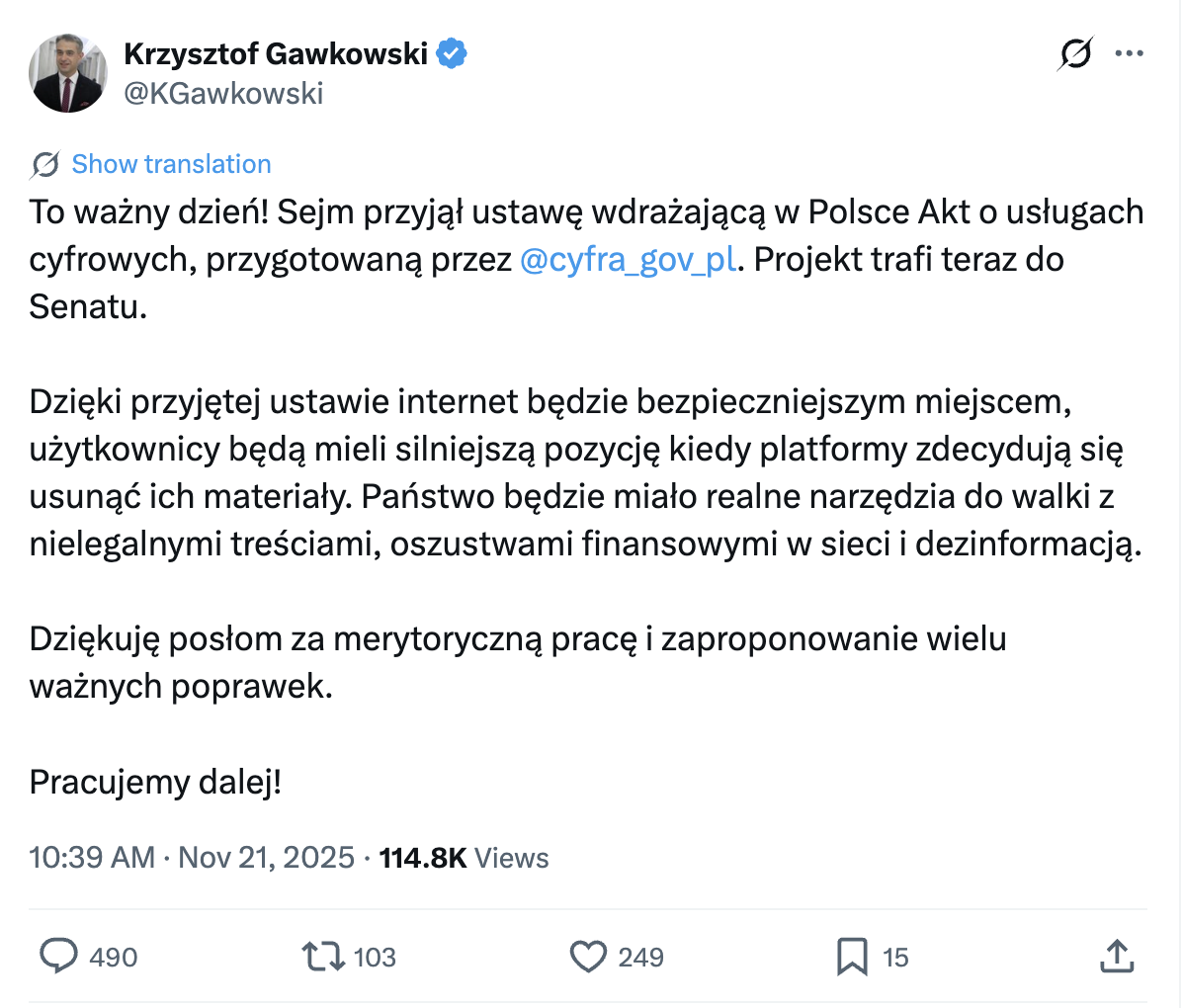

Akt o usługach cyfrowych to unijne rozporządzenie, które ma na celu ujednolicenie zasad funkcjonowania pośredników internetowych w całej Unii Europejskiej. Polska, jako kraj członkowski, miała obowiązek dostosować swoje prawo krajowe do tych wymogów. Ministerstwo Cyfryzacji, kierowane przez wicepremiera Krzysztofa Gawkowskiego, przygotowało projekt ustawy, który właśnie zyskał akceptację Sejmu.

Głównym założeniem regulacji jest zasada: „co jest nielegalne offline, powinno być nielegalne online”. Nowe prawo ma wyposażyć państwo w realne narzędzia do zwalczania patologii cyfrowych, takich jak dezinformacja, oszustwa finansowe czy kradzież tożsamości, jednocześnie zwiększając pozycję użytkownika w starciu z korporacjami technologicznymi.

Zamknięty katalog nielegalnych treści

Kluczowym elementem ustawy jest precyzyjne zdefiniowanie, co podlega blokowaniu. Ustawodawca zdecydował się na tzw. zamknięty katalog przestępstw. Oznacza to, że urzędnicy nie mogą arbitralnie rozszerzać definicji „nielegalnej treści” na inne obszary nieujęte w ustawie.

Do kategorii treści podlegających usunięciu należą materiały związane z:

-

pornografią dziecięcą,

-

handlem ludźmi,

-

kradzieżą tożsamości,

-

zleceniem zabójstwa,

-

namawianiem do samobójstwa.

Taka konstrukcja przepisów ma stanowić bezpiecznik przed nadużyciami i ograniczać ryzyko cenzury prewencyjnej czy politycznej.

Architektura nadzoru: Kto i jak będzie blokował

Nowe przepisy wprowadzają skomplikowany system instytucjonalny odpowiedzialny za egzekwowanie prawa. Procedura usuwania treści nie będzie automatyczna, lecz oparta na wnioskach i decyzjach administracyjnych.

Podmioty uprawnione do wnioskowania:

-

Policja i Prokuratura.

-

Krajowa Administracja Skarbowa (KAS).

-

Straż Graniczna (w określonych przypadkach).

-

Zaufane podmioty sygnalizujące (organizacje eksperckie).

-

Usługobiorcy (zwykli użytkownicy zgłaszający naruszenia).

Organy decyzyjne:

Nakazy usunięcia treści będą wydawane przez dwa główne organy:

-

Urząd Komunikacji Elektronicznej (UKE) – w sprawach ogólnych.

-

Krajowa Rada Radiofonii i Telewizji (KRRiT) – w specyficznym przypadku materiałów wideo.

Procedura przewiduje również tryb odwoławczy (przywrócenie materiałów), co ma chronić użytkowników przed pomyłkami algorytmów lub błędnymi decyzjami urzędników.

Kontrowersje polityczne: Bezpieczeństwo czy cenzura?

Przyjęcie ustawy poprzedziła burzliwa debata, w której starły się dwie narracje: rządowa (bezpieczeństwo) i opozycyjna (wolność słowa).

Argumenty opozycji (PiS, Konfederacja):

Główny zarzut dotyczy ryzyka cenzury. Janusz Cieszyński, poseł PiS i były minister cyfryzacji, wskazał na niebezpieczeństwo przekazania zbyt dużych kompetencji urzędnikom, a konkretnie NASK (Naukowa i Akademicka Sieć Komputerowa). Według opozycji, decyzje o blokowaniu treści powinny pozostawać w wyłącznej gestii niezawisłych sądów, a nie organów administracyjnych czy instytutów badawczych podległych rządowi.

Obawy te zostały wzmocnione przez niedawne wydarzenia związane z wyborami prezydenckimi i śledztwem prokuratury w sprawie nielegalnych spotów wyborczych wymierzonych w Karola Nawrockiego i Sławomira Mentzena. Opozycja obawia się, że mechanizmy DSA mogą zostać wykorzystane do walki politycznej.

Argumenty rządu (KO, Polska 2050, Lewica):

Ministerstwo Cyfryzacji odpiera zarzuty, wskazując na konieczność ochrony podmiotowości użytkowników. Wiceminister Michał Gramatyka (Polska 2050) argumentował, że mechanizmy te mają na celu jedynie przeniesienie standardów świata rzeczywistego do wirtualnego. Jeśli nawoływanie do nienawiści rasowej jest ścigane na ulicy, musi być skutecznie usuwane z platform cyfrowych. Resort podkreśla również, że ustawa nakłada na gigantów technologicznych obowiązek przejrzystości i zapobiegania nadmiernemu usuwaniu treści, co paradoksalnie ma chronić wolność słowa przed arbitralnymi decyzjami korporacji z Doliny Krzemowej.

Wynik głosowania i dalsze kroki

Ustawa została przyjęta większością głosów koalicji rządzącej (237 głosów). Przeciw głosowały kluby PiS, Konfederacji oraz koła Wolni Republikanie i Konfederacja Korony Polskiej. Partia Razem wstrzymała się od głosu. Dokument trafi teraz do Senatu, a następnie do Prezydenta, którego decyzja – w świetle zapowiedzi opozycji i wątpliwości konstytucyjnych – będzie kluczowa dla ostatecznego kształtu regulacji.

FAQ – Najczęściej zadawane pytania

1. Czy urzędnik będzie mógł usunąć mój wpis w mediach społecznościowych, jeśli uzna go za nieodpowiedni?

Nie, urzędnik nie może działać arbitralnie. Ustawa przewiduje zamknięty katalog przestępstw (np. pornografia dziecięca, namawianie do samobójstwa). Decyzje o nakazie usunięcia wydaje UKE lub KRRiT na wniosek uprawnionych służb, a użytkownikowi przysługuje procedura odwoławcza.

2. Jakie konkretnie treści są uznane za nielegalne w świetle nowej ustawy?

Katalog obejmuje m.in. pornografię dziecięcą, kradzież tożsamości, zlecenie zabójstwa, handel ludźmi oraz namawianie do samobójstwa. Są to czyny, które stanowią przestępstwa w rozumieniu Kodeksu karnego.

3. Czy DSA dotyczy tylko wielkich platform jak Facebook czy X (Twitter)?

DSA nakłada obowiązki na różnych pośredników internetowych, ale stopień rygoru zależy od wielkości podmiotu. Największe wymogi dotyczą tzw. bardzo dużych platform internetowych (VLOP), które mają największy wpływ na debatę publiczną i bezpieczeństwo użytkowników.

4. Dlaczego opozycja twierdzi, że ustawa wprowadza cenzurę?

Opozycja obawia się, że przekazanie kompetencji do blokowania treści organom administracyjnym (UKE, KRRiT) oraz rola NASK (podległego rządowi) może prowadzić do nadużyć politycznych. Postulują, aby o blokowaniu treści decydowały wyłącznie sądy, co gwarantowałoby niezawisłość procesu.

5. Co się stanie, jeśli moje treści zostaną usunięte przez pomyłkę?

Ustawa wdrażająca DSA wprowadza mechanizmy odwoławcze (procedura „put back”). Użytkownik, którego treści zostały niesłusznie zablokowane, ma prawo żądać ich przywrócenia, a platformy oraz organy nadzorcze są zobowiązane do rozpatrzenia takiego odwołania.